是的,苹果也会在 iPhone 15 上“伪造”变焦照片——但能做到什么程度呢?

本周您可能已经看到过有关三星 Galaxy S23 Ultra 拍摄所谓”假”月球照片的头条新闻。自 S20 Ultra 以来,三星就有了一项名为 Space Zoom 的功能,将 10 倍光学变焦与大规模数字变焦相结合,达到 100 倍组合变焦。在营销照片中,三星展示了其手机拍摄近乎晶莹剔透的月球照片,用户在晴朗的夜晚也做了同样的事情。

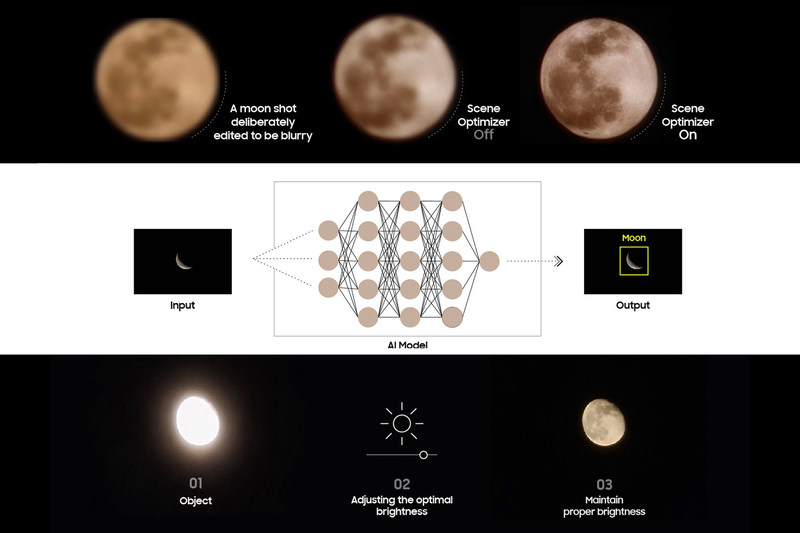

但是Redditor 已经证明三星令人难以置信的 Space Zoom 使用了一些诡计。事实证明,在拍摄月球照片时,三星基于人工智能的场景优化器做了很多繁重的工作,使其看起来像是用高分辨率望远镜而不是智能手机拍摄的。因此,当有人在天空或电脑屏幕上拍摄月亮时(如 Reddit 帖子中所示),三星的计算引擎会接管并清除相机错过的陨石坑和轮廓。

在后续帖子,他们毫无疑问地证明三星确实在照片中添加了”月亮”图像让拍摄更清晰。正如他们解释的那样,”计算机视觉模块/人工智能识别月球,你拍摄照片,此时,经过无数月球图像训练的神经网络填充了光学无法获得的细节。”这比三星透露的更”假”,但仍然非常值得期待。

即使没有调查工作,S23自然也无法拍摄清晰的月球照片,这应该是相当明显的。虽然三星表示使用 S23 Ultra 进行太空变焦拍摄”能够从令人难以置信的 330 英尺远的地方捕捉图像”,但月球距离我们有近 234,000 英里或大约 1,261,392,000 英尺。它的大小也是地球的四分之一。毕竟,智能手机可以轻松拍摄 330 英尺外的摩天大楼的清晰照片。

当然,月球的距离并不能说明全部情况。月亮本质上是黑暗背景下的光源,因此相机需要一些帮助才能捕捉到清晰的图像。以下是如何三星解释道:”当您拍摄月球照片时,您的 Galaxy 设备的相机系统将利用这种基于深度学习的人工智能技术以及多帧处理来进一步增强细节。请继续阅读,了解有关提供高质量月球图像的多个步骤、流程和技术的更多信息。”

这与肖像模式、肖像照明、夜间模式,魔术橡皮擦,或面部取消模糊。这一切都是利用计算意识来添加、调整和编辑不存在的东西。就月球而言,三星的人工智能很容易让手机看起来像是在拍摄令人难以置信的照片,因为三星的人工智能知道月球是什么样子。这就是为什么天空有时看起来太蓝或草太绿的原因。照片引擎正在将其所知道的应用到所看到的内容中,以模仿高端相机并弥补普通智能手机的缺点。

这里的区别在于,虽然拍照算法通常将图像分割成多个部分并对它们应用不同的调整和曝光控制,但三星还在月球上使用有限形式的人工智能图像生成来融合细节这些从一开始就没有出现在相机数据中,但您不会知道,因为从地球上观看时,月球的细节看起来总是一样的。

三星表示,S23 Ultra 的摄像头使用场景优化器的”基于深度学习的 AI 细节增强引擎,可有效消除剩余噪音并进一步增强图像细节。”

三星

苹果会做什么?

据传苹果将在 iPhone 上添加潜望式变焦镜头 15 Ultra 今年首次亮相,这场争议无疑将影响它如何训练人工智能。但您可以放心,计算引擎将像现在一样在幕后完成大量繁重的工作。

这就是智能手机摄像头如此出色的原因。与傻瓜相机不同,我们的智能手机拥有强大的大脑,可以帮助我们拍摄更好的照片,并使糟糕的照片看起来更好。它可以使夜间照片看起来像是在良好的光线下拍摄的,并模拟超快光圈相机的散景效果。

这将使 Apple 通过 6 倍光学相机的 20 倍或 30 倍变焦获得令人难以置信的效果。由于 Apple 迄今已避开天文摄影,我怀疑它是否会采样更高分辨率的月球照片来帮助 iPhone 15 拍摄更清晰的照片,但可以肯定的是,它的光子引擎将努力清理边缘,保留细节并增强长焦相机的功能。根据我们在 iPhone 14 Pro 中得到的结果,结果肯定会非常惊人。

无论是三星还是苹果,计算摄影技术在过去几年中实现了一些最大的突破,而我们仅仅触及了它的皮毛。这些都不是真实的。如果是这样,我们对用智能手机拍摄的照片就不那么印象深刻了。